Estamos diante de um momento decisivo na regulamentação da Inteligência Artificial (IA) no Brasil. O Projeto de Lei 2.338/2023, que agora avança com um substitutivo robusto e detalhado, exige nossa atenção e participação ativa. Este é um chamado a todos os profissionais de tecnologia, Data Protection Officers (DPOs), e especialistas em regulamentação digital para contribuírem nesse processo essencial.

O substitutivo apresentado propõe uma série de novas obrigações e restrições, aumentando significativamente a responsabilidade e a regulamentação em torno dos usos da IA, com especial atenção aos usos de alto risco. Esta versão é 60% maior que o texto original, refletindo uma revisão substancial que visa alinhar nossas normativas às práticas internacionais, enquanto considera as peculiaridades do cenário nacional.

O substitutivo é um texto em larga escala novo, contendo 51% mais artigos e 62% mais instrumentos regulatórios que o PL original. Adicione-se a isso que a maioria dos instrumentos vistos anteriormente tiveram sua redação atualizada, resultando em uma redação praticamente nova a ser analisada.

A característica mais representada no texto é a proposição de novas obrigações e restrições (presentes em 35% do texto). Já a segunda principal característica são as menções a instrumentos que definem o formato regulatório (29% do texto). Em ambos os casos há proposição de novas regras que já existem em legislação atual, incluindo as setoriais. Nesse sentido, é relevante notar que o relaxamento de obrigações é presente em pequena parte, como o é o formato de autorregulação. Nesse sentido, o substituto representa uma forte interferência no mercado, ao atrair para si o poder de regular, e ao impor obrigações a praticamente todos os usos de IA.

O tema mais ausente do substitutivo é o fomento à inovação, presente em apenas 5% do texto. Há quase ausência de instrumentos versando sobre sandbox (3 instrumentos apenas), como também quase ausência de instrumentos sobre pequenas e médias empresas (3 instrumentos apenas) e startups (2 instrumentos apenas). O substituto assim diverge do marco europeu, que possui mais ênfase a esses temas. Nesse sentido, vai também contra a EBIA e o acórdão do TCU sobre o tema.

O substituto ainda aumenta as obrigações sobre os usos de IA de risco mínimo, tratando estes como mais graves que o comparativo europeu. Isso se dá porque na Lei de Inteligência Artificial Europeia há distinção entre usos de risco limitado e mínimo. Já no substituto, estes são tratados como categoria residual, combinados, o que acaba por elevar as obrigações sobre usos de risco mínimo, que representa o grande mercado potencial da tecnologia.

Cerca de um terço dos instrumentos do substituto fazem referência ao marco europeu, indicando uma evidência do “Efeito Bruxelas”. Apesar da referência evidente, trata-se de uma redação original, na qual as similaridades representam efeitos diversos. Há casos de equivalência total (como na definição de sistema de IA), casos em que a equivalência gera resultados opostos (como no caso das sandboxes, adotado na Lei europeia como dever do Estado, e aqui como faculdade do Estado), e casos em que a equivalência leva a inovações regulatórias (como no direito à explicação).

INTRODUÇÃO

Onde nos encontramos

O PL 2.338/2023 foi criado como anteprojeto de lei por uma comissão de juristas, e tornou-se projeto de lei pelo Presidente do Senado, Rodrigo Pacheco, em maio de 2023. A relatoria do projeto é ocupada pelo Sen. Eduardo Gomes, e a tramitação apensada ao projeto de lei já aprovado na Câmara, o 21/2020, de autoria do Deputado Eduardo Bismarck, e relatoria da Deputada Luísa Canziani.

Passado um ano de tramitação no Senado, em 24 de abril, um substitutivo foi apresentado aos pares. O gabinete do relator anunciou recebimento de contribuições, por escrito, nas seguintes duas semanas.

Até o momento, nem a versão atualizada do projeto de lei, nem a tomada de contribuições sobre o texto foi formalizada.

Quão novo é o substituto do PL 2.338/2023?

Comparando o texto original ao substituto do projeto de lei, pode-se dizer que se trata de uma grande atualização.

- O texto do substituto cresceu de 45 para 68 artigos (51% de crescimento);

- O texto novo saltou de 270 para 438 dispositivos (62% de crescimento)

- A grande maioria dos instrumentos comuns aos dois textos possui redação diferente.

Assim, em linhas gerais, podemos dizer que o substituto é 60% maior que o projeto de lei original. Efeito similar ocorreu com a Lei de Inteligência Artificial Europeia (o EU AI Act), na qual o texto aprovado saltou de 85 para 113 artigos (33% de aumento), além do aumento de anexos e outros textos.

Vale notar que os textos repetidos entre a versão original e o substituto do marco nacional são, em sua maioria, alterados, representando uma versão praticamente nova e ampliada.

PERFIL GERAL

Qual o perfil geral do substituto?

Dentre os 438 instrumentos analisados (incluindo aqui artigos, incisos, alíneas e parágrafos e similares), identificamos que:

- A maior característica do texto é tratar de obrigações e restrições, que ocupam mais de 1/3 do texto proposto (35%). Incluem-se aqui obrigações (gerais, específicas para uso de alto risco, e pelo Poder Público) e relaxamentos de obrigações;

- A segunda maior característica do texto é tratar do formato regulatório, que ocupa quase 1/3 do texto proposto (29%). Incluem-se aqui as formas de regulação pelo Estado (concentrada e distribuída) e a autorregulação.

- Direitos e conceitos gerais ocupam 1 em cada 5 instrumentos do texto (20%). Incluem-se aqui as definições, fundamentos, princípios e direitos propriamente dito.

- Em antepenúltimo lugar, o regime de responsabilidade respondo por 10% do texto, incluindo-se aqui definições sobre o regime aplicável, e as penalidades.

- Em penúltimo lugar, os instrumentos de inovação ocupam 5% do texto.

- Em último lugar, com 2%, estão instrumentos internos da regulação (como período de vacância).

CARACTERÍSTICAS ESPECÍFICAS

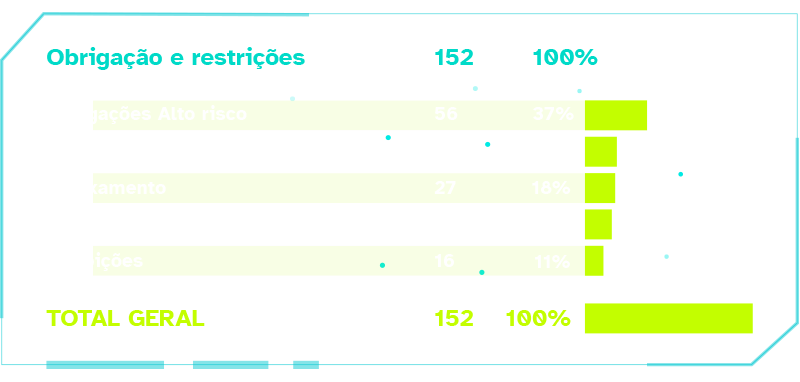

Obrigações e restrições

Obrigações e restrições estão presentes em 35% de todo texto, e referem-se a práticas introduzidas para evitar ou mitigar riscos. 32 dos 68 (47%) dos artigos fazem alguma referência a esse tema. Dentre os 152 instrumentos encontrados:

- 37% das obrigações dizem respeito ao uso de IA de alto risco (56 instrumentos). Exemplos de textos incluídos aqui são aqueles que caracterizam quais aplicações possuem alto risco, como também obrigações relacionadas, como relatório de impacto e supervisão humana.

- 19% das obrigações aplicam-se a qualquer tipo de uso de IA (29 instrumentos). Exemplos de textos incluídos aqui incluem obrigações de análise preliminar, comunicação de incidentes, transparência, dentre outroas.

- 18% das obrigações referem-se a relaxamento de dispositivos gerais (27 instrumentos). Esses são casos de exceção ou faculdade de aplicação de obrigações, como usos específicos ou privilégios por boa-fé ou compliance.

- 16% das obrigações aplicam-se apenas aos usos pelo Poder Público (24 instrumentos). Incluem-se aqui textos sobre uso de alto risco, uso geral, e obrigações específicas ao uso para o interesse público da IA.

- 11% das obrigações descrevem os usos proibitivos (16 instrumentos), e referem-se a casos em que o risco é considerado excessivo para uso.

Um ponto de atenção é a relação entre usos, obrigações, e níveis de risco. O PL 2.338/2023 é inspirado no modelo de risco do EU AI Act, que na sua versão original possuía quatro categorias de risco:

Structure a ‘risk-based’ approach

- No alto da escala de riscos estão os usos de risco excessivo, e portanto proibidos. Essa é uma categoria presente tanto no EU AI Act como no PL 2.338/2023. Como visto acima, respondem por 11% das obrigações do texto.

- Logo abaixo na escala de risco encontram-se os usos de alto risco, que envolvem compliance antecipado, obrigações adicionais e restrições. Como no caso acima, essa é uma categoria presente no instrumento europeu e brasileiro. Como visto acima, respondem por 37% das obrigações do texto.

- No texto do EU AI Act seguiriam duas outras categorias: as de risco limitado (que possuem obrigações de transparência, para monitoramento do risco previsto) e as de risco mínimo (que seguem princípios de autorregulação, como códigos de conduta).

- Já no texto do PL 2.338/2023 todos os casos que não se enquadrem em risco excessivo ou alto risco são colocados na mesma categoria, como residuais. Dessa forma, não adotamos no texto brasileiro a mesma atenção dada no texto europeu aos usos de baixo risco.

Sendo assim, duas características do substitutivo são:

- O foco majoritário do texto está nos usos de alto risco, e não sobre todos os níveis de usos de inteligência artificial (em especial as de risco limitado ou mínimo)

- Os riscos de gradação mais baixa, como risco limitado e mínimo, são apresentados em conjunto, o que aumenta as obrigações sobre aqueles usos de risco mínimo.

Formato regulatório

Formato regulatório está presente em 29% de todo texto, e refere-se ao texto que define formas de controle pelo Estado, ou pelo setor privado. 25 dos 68 (37%) dos artigos fazem alguma referência a esse tema. Dentre os 128 instrumentos encontrados:

- Mais da metade (61%) do texto define o formato concentrado de regulação estatal (78 instrumentos). A regulação concentrada refere-se a poderes que um órgão, sozinho, tem a capacidade de decidir. Exemplos de regulação concentrada são aqueles textos que definem e caracterizam o SIA.

- 21% dos artigos definem o formato distribuído de regulação estatal (27 instrumentos). A regulação distribuída diz respeito à obrigação de mais de um órgão tomar decisões, seja através de decisão conjunta ou com consulta a outros órgãos, como no caso das obrigações da SIA consultar agências reguladoras setoriais.

- 18% dos artigos definem o formato de autorregulação (23 instrumentos), e referem-se a características do código de conduta, de associação entre si, compartilhamento de experiências, dentre outros.

O que se percebe é que o formato de regulação mais detalhado é aquele conduzido pelo Estado, e por um órgão superior aos demais, no caso, o SIA. Compartilhamento de decisão com outros órgãos, e autorregulação, aparecem em quantidade similar, mas em grau diminutivo.

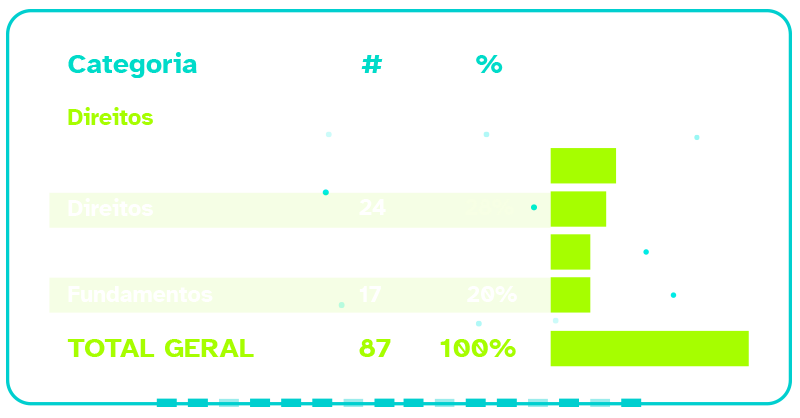

Direitos e definições

Direitos e definições estão presentes em 20% de todo texto, e referem-se ao texto que define direitos, fundamentos, princípios e definições. 12 dos 68 (18%) dos artigos fazem alguma referência a esse tema. Dentre os 87 instrumentos encontrados:

- 29 instrumentos (33% do grupo) introduzem definições no texto. Essa é uma característica também encontrada no EU AI Act, mas que no texto substituto possuem algumas categorias similares, mas muitas novas, como as definições variadas relacionadas à IA generativa (não encontradas na mesma capilaridade no EU AI Act).

- 24 instrumentos (28% do grupo) introduzem direitos no texto. Direitos podem ser individuais, coletivos ou ambos, e por vezes detalham direitos dos agentes responsáveis pelos usos de IA.

17 instrumentos (20% do grupo) introduzem princípios no texto, e a mesma proporção define fundamentos. Os princípios e fundamentos possuem, em muitos casos, grande semelhança aos introduzidos pelo EU AI Act, e à Lei Geral de Proteção de Dados nacional, embora sejam adaptados ao contexto nacional específico.

Regime de responsabilidade

Regime de responsabilidade está presente em 10% de todo texto, e refere-se 42 instrumentos, presentes em 7 dos 68 artigos (10%). Em torno de metade do texto define penalidades (57%), e a outra metade tipos de responsabilidade (43%).

Inovação

Inovação está presente em 5% do texto, composta por 21 dos instrumentos, incluídos em 11 dos 68 artigos (16%). Dos instrumentos descritos, 4 referem-se ao mecanismo de sandbox (sendo 3 instrumentos de fomento, e 1 de restrição) e os demais a fomento em geral (como permissão para uso de recursos públicos).

Inovação relacionada ao fomento às pequenas e médias empresas aparecem em dois instrumentos, e startups em apenas 1 instrumento, sendo temas quase ausentes na regulação.

Nessa direção, o substitutivo vai de encontro ao Acórdão 616/2024 do TCU, que enfatiza que regulações excessivas estimulam o monopólio de poucas empresas financeiramente capazes de arcar com os custos, e diminui a oportunidade de startups e empresas de menor porte. Estaria assim, indo ao encontro da Estratégia Brasileira de Inteligência Artificial, a EBIA.

Paralelos com a Lei Europeia de Inteligência Artificial

Uma característica do substitutivo é o alto grau de paralelismo com a Lei de Inteligência Europeia. Além da estrutura similar (como divisão em risco alto e excessivo, e a designação de autoridade reguladora ou de fomento à inovação através de sandbox), quase metade dos instrumentos na versão brasileira são inspirados na versão europeia.

O paralelismo entre o marco europeu e a proposta brasileira não significa, necessariamente, que as normas propostas sejam equivalentes. Há casos em que isso é verdade, e a similaridade resulta em normas equivalentes (como no caso da definição de sistema de IA, igual nos dois textos). Mas há casos em que o resultado do paralelismo não resulta em equivalência.

Em alguns casos, a similaridade entre normas existe, mas o texto nacional modifica o conteúdo da norma europeia (como no caso de vários instrumentos sobre definições, fundamentos e princípios). E há casos em que o paralelismo resulta em uma inversão normativa, ou seja, em antagonismo. Esse é o caso dos instrumentos sobre sandboxes, na qual o texto brasileiro define como uma faculdade do Estado, e a norma europeia como um dever do Estado).

Cerca de 30% dos instrumentos do PL possuem forte equivalência com o marco europeu.

Mais do que nunca, é crucial que a comunidade tecnológica e os profissionais de proteção de dados estejam engajados. As decisões tomadas agora irão moldar o futuro do desenvolvimento tecnológico e da inovação no país. O texto do substitutivo, embora extenso e abrangente, carece de maior foco em inovação e apoio às startups e pequenas empresas, áreas vitais para a sustentação de um ecossistema tecnológico saudável e competitivo.

Nos próximos passos deste processo, o gabinete do relator do projeto convida todos a enviarem contribuições por escrito. Esta é uma oportunidade para que nossa voz seja ouvida e nossas experiências informem a legislação. A participação de cada um é fundamental para garantir que o marco regulatório de IA seja justo, equilibrado e proporcione um ambiente favorável à inovação e ao desenvolvimento tecnológico.

Portanto, convido todos os interessados e especialistas no setor a se engajarem ativamente. Analisem o substitutivo, consultem seus pares e preparem suas contribuições. Juntos, podemos assegurar que a regulamentação da IA no Brasil seja um exemplo de equilíbrio entre segurança, privacidade e inovação.

A construção de um marco regulatório eficaz para a inteligência artificial não é apenas uma questão técnica, mas também uma profunda responsabilidade ética e social. À medida que a IA se torna mais integrada em diversos aspectos de nossas vidas, desde sistemas de saúde até soluções de segurança pública, é imperativo que as regulamentações acompanhem não só o ritmo da inovação tecnológica, mas também os imperativos de proteção de dados, privacidade e ética. Esse engajamento não só ajuda a moldar uma legislação que seja verdadeiramente representativa das necessidades e preocupações dos brasileiros, mas também reforça o papel do Brasil como um líder em governança digital responsável no cenário mundial.

Destacamos a importância de um diálogo aberto e contínuo entre os formuladores de políticas, especialistas técnicos, o setor privado e a sociedade civil. Este é um convite à colaboração, onde cada perspectiva pode contribuir para um framework regulatório que promova tanto a inovação quanto a segurança. A tecnologia de IA, com seu vasto potencial de transformação, exige uma abordagem regulatória que seja flexível e adaptável. As contribuições da comunidade tecnológica são essenciais para alcançar esse equilíbrio, garantindo que o desenvolvimento da IA no Brasil seja sustentável, ético e alinhado com os valores de nossa sociedade.

Seu conhecimento e expertise são indispensáveis. Participe e ajude a moldar o futuro da tecnologia no Brasil! Venha com o Movimento Inovação Digital!

Entre em contato conosco!

presidencia@movimentoinova.com.br – WhatsApp (11) 98426-4469